728x90

반응형

데이터센터 간 KVCache 전송을 통한 LLM 추론 혁신

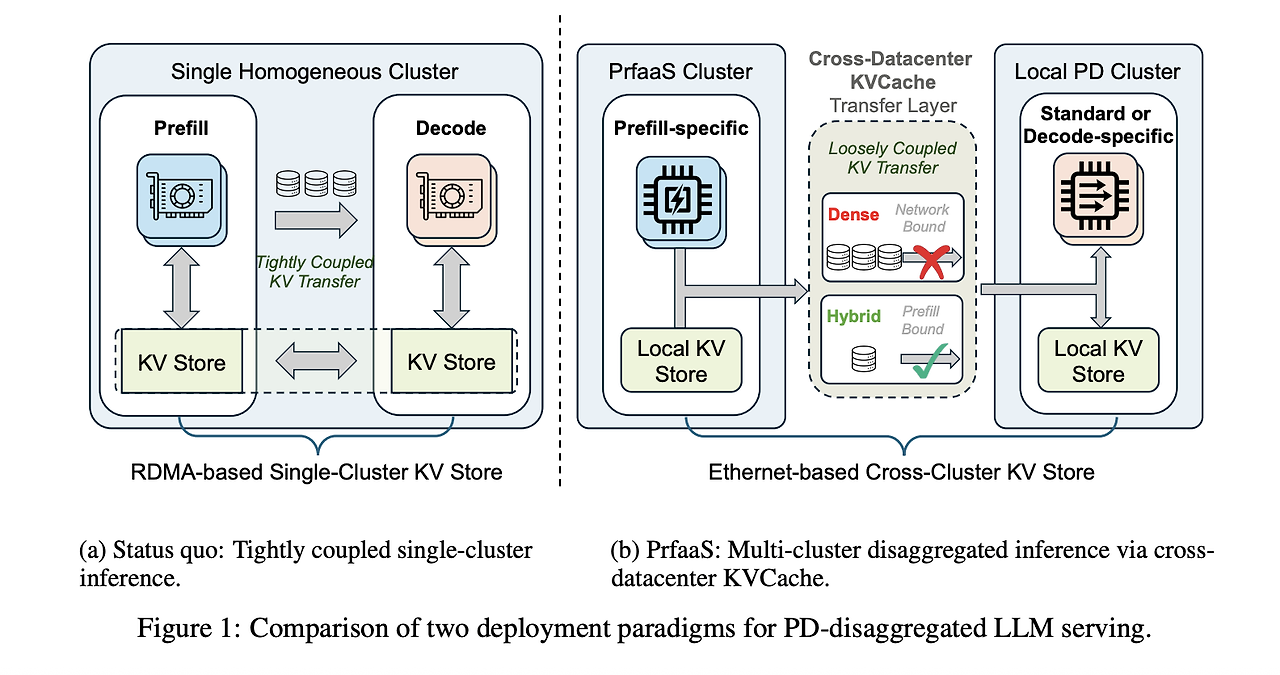

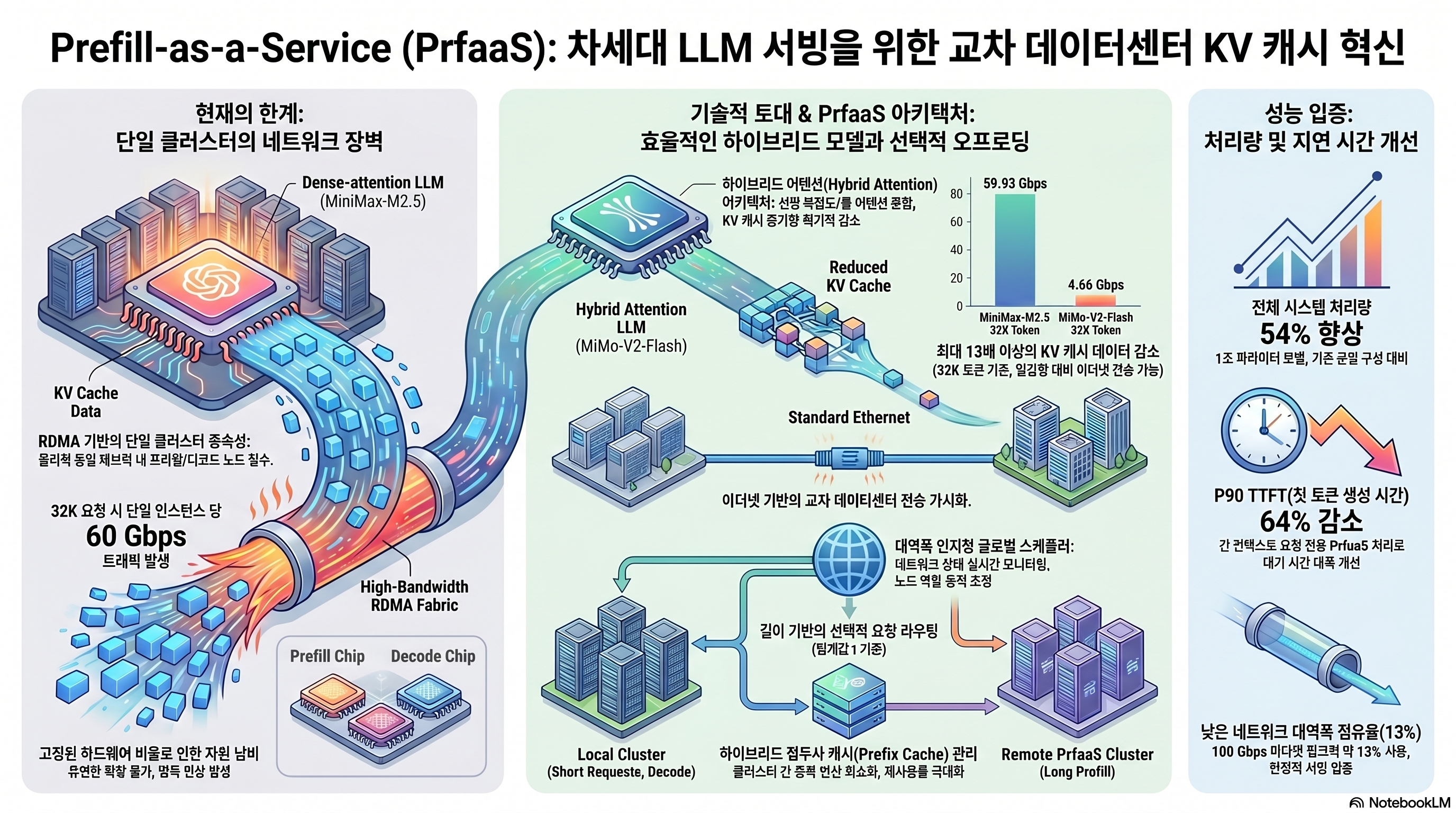

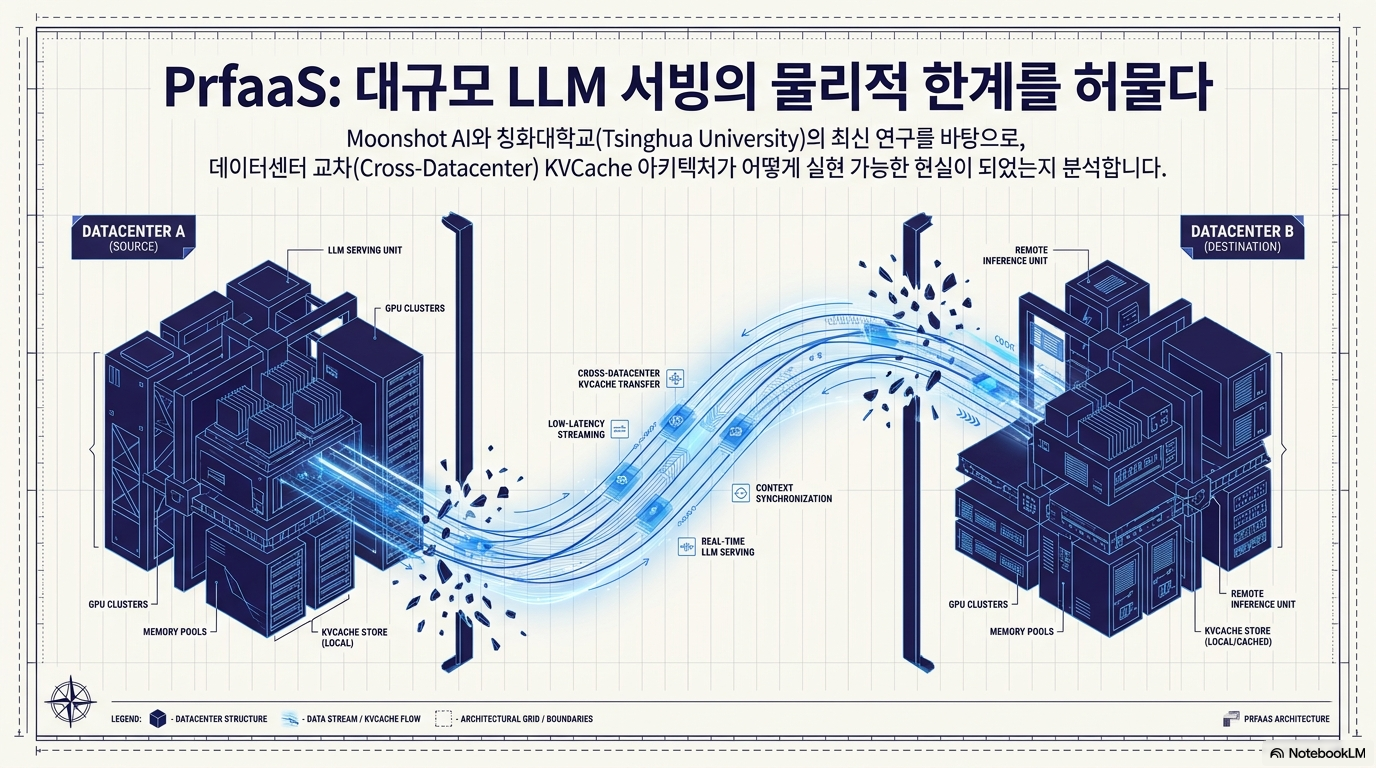

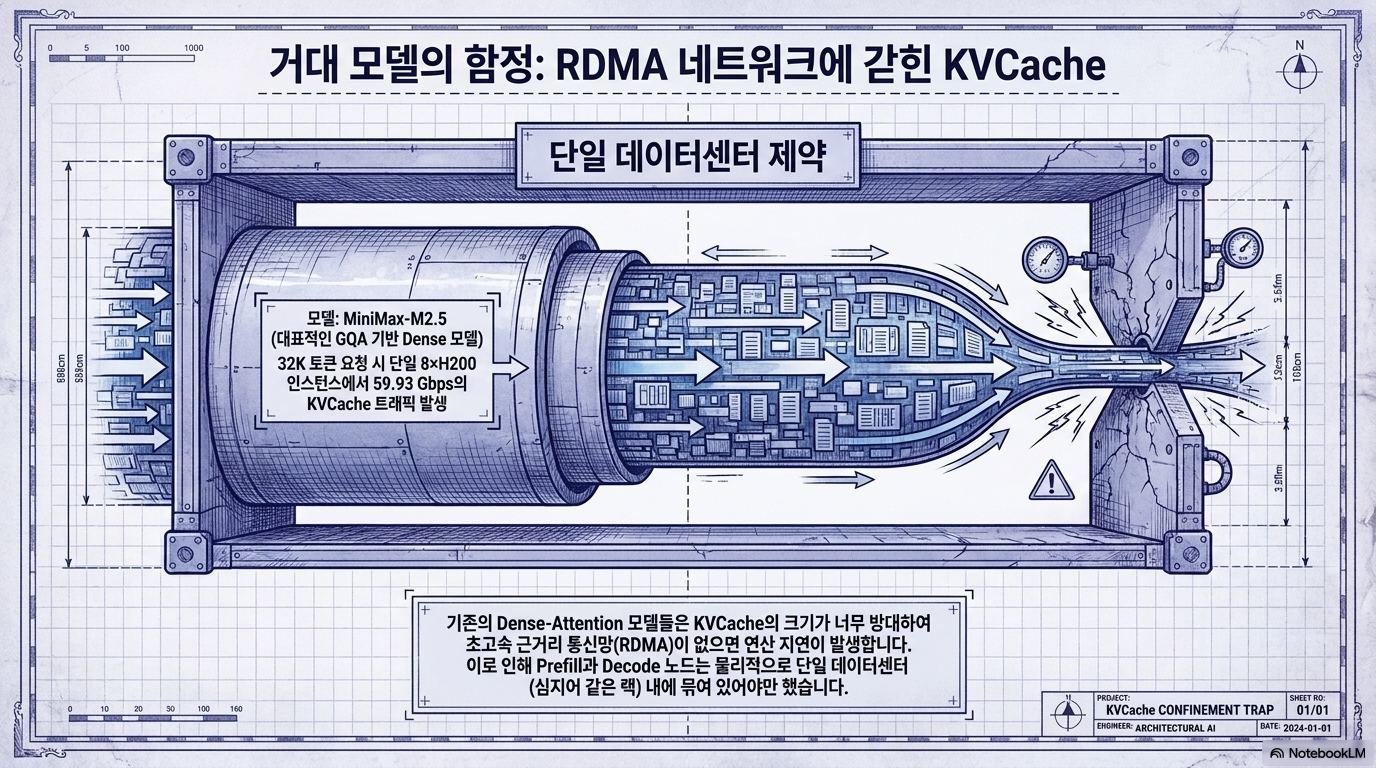

이 자료는 Moonshot AI와 칭화대학교 연구진이 공동 개발한 PrfaaS(Prefill-as-a-Service)라는 새로운 대규모 언어 모델 서빙 아키텍처를 소개합니다. 기존의 방식은 데이터 전송량 문제로 인해 모든 추론 과정을 하나의 데이터 센터 내에 묶어두었으나, 연구진은 하이브리드 어텐션 기술을 활용해 데이터 크기를 획기적으로 줄임으로써 교차 데이터 센터(Cross-Datacenter) 환경에서도 효율적인 작업 분배가 가능함을 입증했습니다. 이 시스템은 계산 집약적인 프리필(Prefill) 단계를 원격 클러스터로 분리하고 일반 이더넷 망으로 데이터를 전송하며, 이중 시간척도 스케줄러를 통해 전체 처리량을 최적화합니다. 결과적으로 이 혁신적인 구조는 하드웨어 비용 대비 성능을 극대화하고 초기 응답 시간(TTFT)을 대폭 단축하여, 향후 더 거대한 모델을 효율적으로 운영할 수 있는 실질적인 해법을 제시하고 있습니다.

728x90

'12. 메일진' 카테고리의 다른 글

| 클라우드 컴퓨팅 - AI - 네오클라우드(Neocloud) 미시경제학 (0) | 2026.04.22 |

|---|---|

| 클라우드 컴퓨팅 - AI - 코어위브(CoreWeave) 네오클라우드 (0) | 2026.04.22 |

| 생성형 AI - 월드 모델 (World Model) - MIT, MDGen (병렬 확산) (0) | 2026.04.21 |

| 생성형 AI - 월드 모델 (World Model) - 거대 X 모델(Large X Models) (0) | 2026.04.21 |

| 생성형 AI - 월드 모델 (World Model) - 엔비디아 코스모스 모델 (0) | 2026.04.21 |