https://fundaai.substack.com/p/deepllm-frontier-compute-for-agi

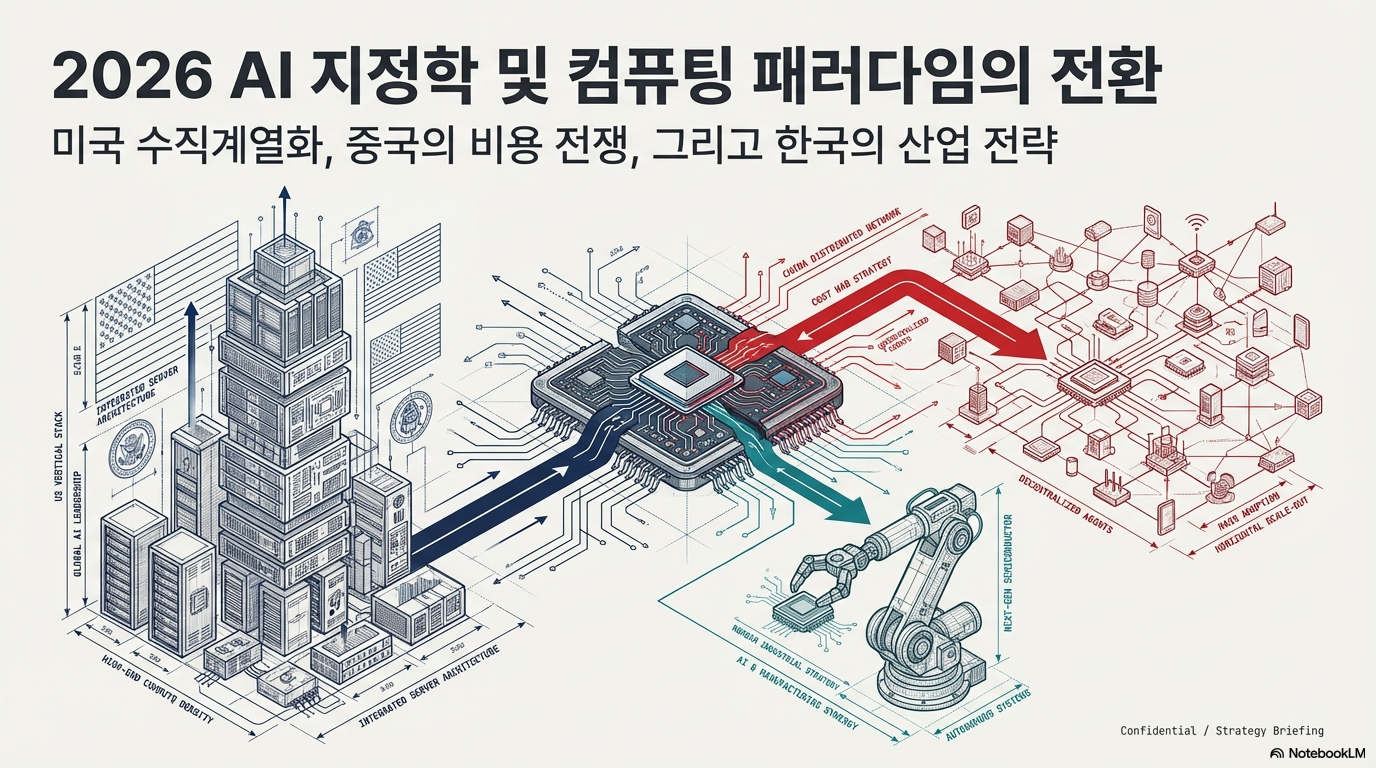

이 자료들은 2026년 초반 인공지능 산업의 패러다임 변화와 주요 국가 간의 전략적 차이를 분석하고 있습니다.

미국은 거대 컴퓨팅 인프라를 바탕으로 범용 인공지능(AGI)을 추구하는 반면, 중국은 비용 효율성과 에이전트 서비스 중심의 대중적 확산에 집중하며 시장이 이분화되는 양상을 보입니다.

기술적 경쟁의 핵심은 단순히 칩의 개수를 늘리는 단계에서 벗어나, 전력 관리와 시스템 통합 능력을 최적화하는 '데이터 이동' 및 '추론 경제'의 영역으로 진화했습니다. 구글과 오픈AI 같은 선두 기업들은 수직 계열화된 자체 가속기와 맞춤형 설계를 통해 하드웨어 한계를 극복하며 수익성을 개선하고 있습니다.

결과적으로 AI는 단순한 소프트웨어 개발을 넘어 에너지와 인프라가 결합된 유틸리티 산업으로 변모하고 있으며, 지속 가능한 운영 효율성이 기업의 생존을 결정하는 중추적 요인이 되었습니다.

이처럼 현대의 AI 경쟁은 연구 중심에서 엔지니어링과 운영 역량이 융합된 다차원적 구조로 재편되었습니다.

2026 AI 추론 경제(Inference Economy)의 도래와 기업의 수익 최적화 전략

1. 서론: AI 산업의 패러다임 시프트 - '학습'의 시대에서 '추론 유틸리티'의 시대로

2026년 현재, 글로벌 AI 산업은 기술적 가능성을 탐색하던 'R&D 단계'를 지나, 경제적 실효성이 생존을 결정짓는 '추론 경제(Inference Economy)' 단계로 완전히 진입했습니다. 지난 수년간의 경쟁이 더 방대한 데이터로 모델을 가르치는 '학습'에 집중되었다면, 이제는 구축된 지능을 얼마나 효율적으로 대규모 배포하고 수익화하느냐가 핵심입니다.

현시점의 AI는 단순한 소프트웨어 레이어를 넘어 에너지, 데이터센터, 시스템 공학이 결합된 거대 유틸리티 산업으로 변모했습니다. 이는 19세기 철도망이나 20세기 전력망 구축기와 유사한 '초기 인프라 건설 단계'의 양상을 띠고 있습니다. 이제 기업의 의사결정권자들에게 AI는 '무엇을 할 수 있는가'라는 기술적 호기심의 대상이 아니라, 분기별 영업비용(OpEx)의 변동성을 결정짓는 '결정론적 재무 변수'로 다루어져야 합니다.

산업의 근본적인 동학이 '컴퓨트 레이스'에서 '데이터 이동 레이스'로 변화함에 따라, 기업이 직면한 구체적인 전략적 전환점을 분석하겠습니다.

2. 추론 경제의 핵심 동인: 토큰당 비용(Cost per Token)과 모델 선택의 전략적 의도

추론 경제 시대에 모델 성능(Intelligence)과 운영 비용(Token Cost) 사이의 균형은 기업 재무 계획의 핵심 요소입니다. 특히 2026년에 들어서며 프런티어 랩들의 전략은 무조건적인 규모 확장(Scaling)에서 '운영 효율 최적화'로 선회하고 있습니다.

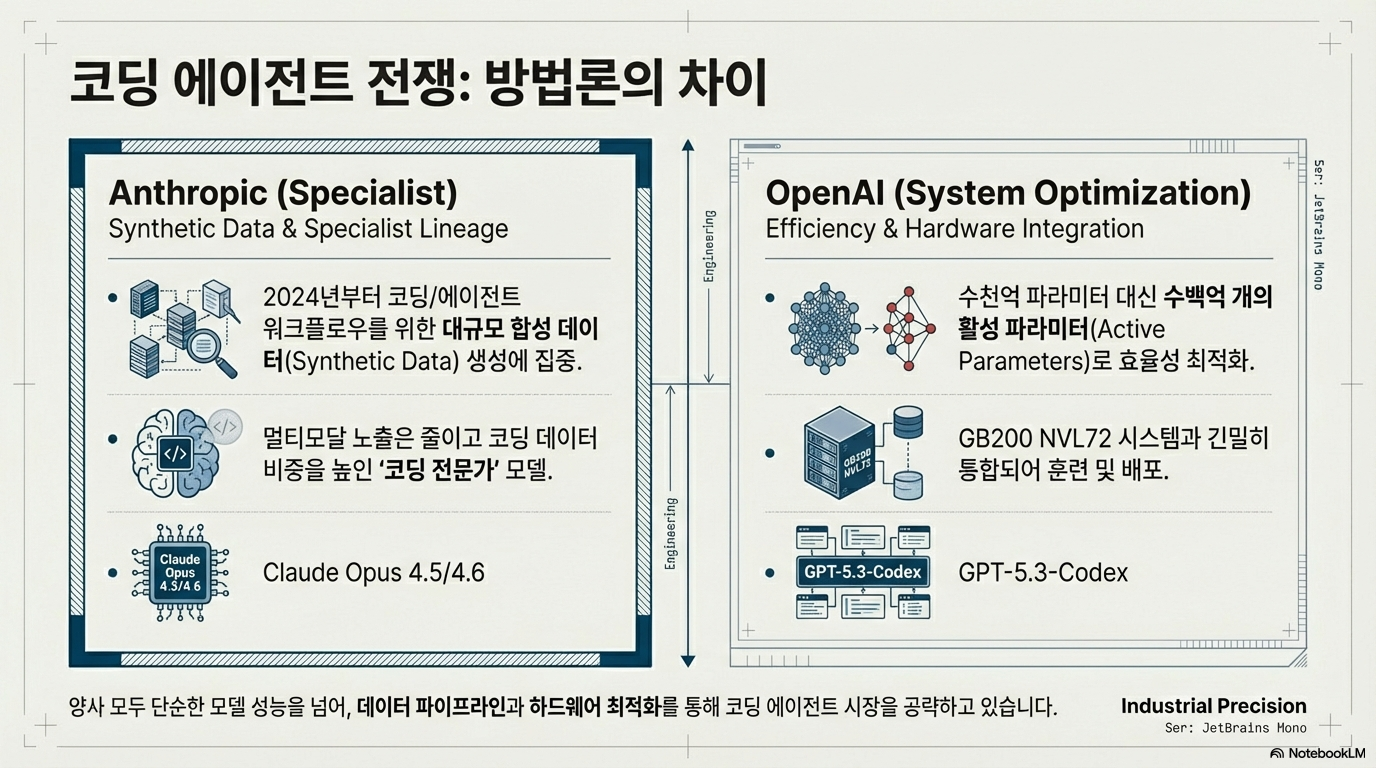

가장 주목할 지점은 모델 아키텍처의 분화입니다. OpenAI의 GPT-5.3-Codex는 수천억 개의 파라미터를 사용하는 Anthropic의 Claude Opus 4.5/4.6과 달리, 활성 파라미터(Active Parameters)를 수백억 개 수준으로 억제하면서도 GB200 NVL72 인프라와의 수직 계열화를 통해 압도적인 추론 효율을 달성했습니다. 이는 지능의 총량보다 '지능의 단위 원가'를 낮추는 것이 시장 지배력의 원천이 되었음을 시사합니다.

| 구분 | 프런티어 모델 (Frontier Focus) | 비용 최적화 모델 (Efficiency Focus) |

| 주요 모델 | Claude Opus 4.5/4.6, Gemini 3.0 | Kimi K2.5, DeepSeek V3.2, MiniMax M2.5 |

| 핵심 지표 | 고난도 다단계 추론, 복합 멀티모달 | 토큰당 비용, 응답 속도, MoE 최적화 |

| 시스템 통합 | 고대역폭 인터커넥트 기반 대규모 클러스터 | 추론 엔지니어링 및 에이전트 전용 엔진 |

| 재무적 의도 | AGI 달성을 위한 기술적 해자 구축 | 시장 점유율 확대를 위한 가격 파괴 전략 |

| 전략적 특징 | GPT-5.3: 수백억 개 활성 파라미터로 효율 극대화 | 중국계 모델: MoE 구조 최적화로 'Good enough' 성능 제공 |

이러한 비용 중심적 사고는 '에이전트 워크플로우'가 보편화되면서 기업의 생존을 가르는 임계점을 형성하고 있습니다.

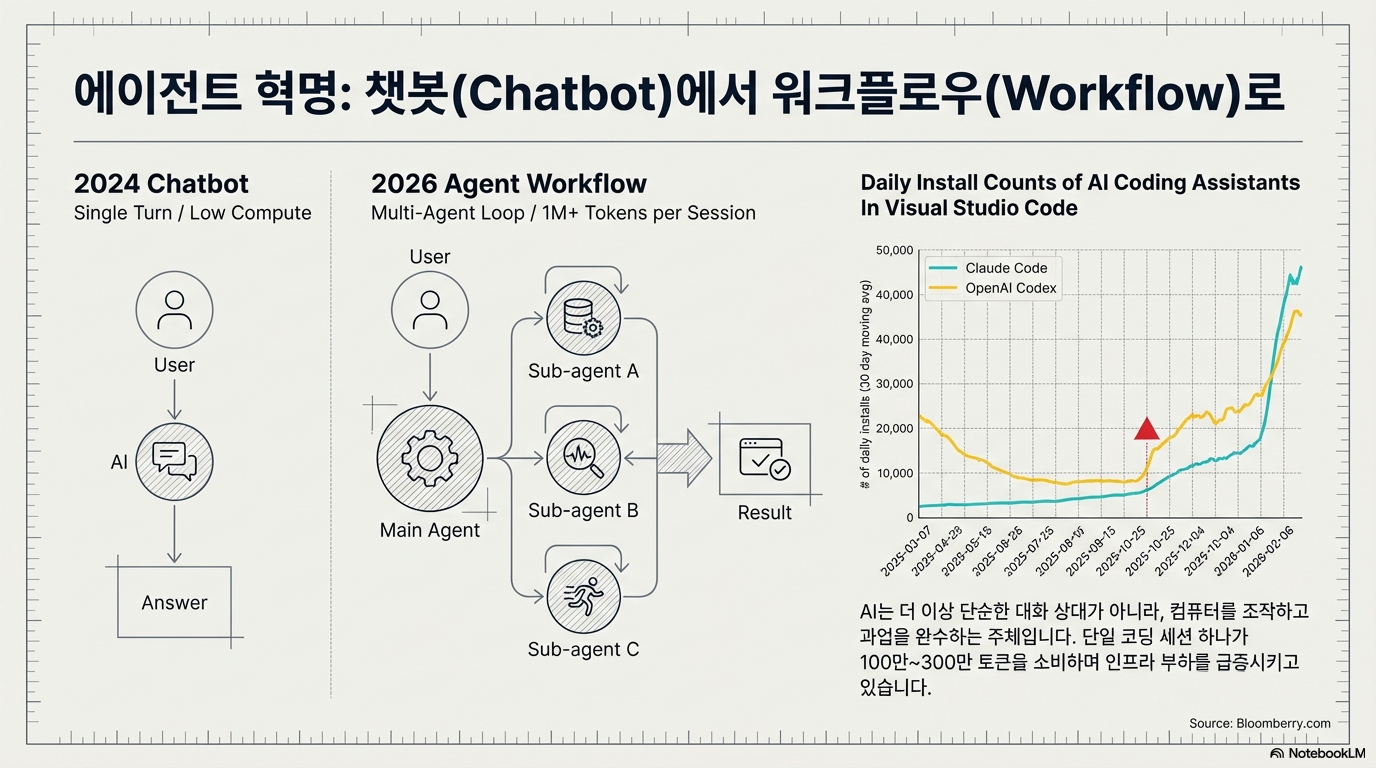

3. 에이전트 혁명과 토큰 소비 패턴의 변화: OpenClaw와 '수행' 중심의 AI

최근 OpenClaw 프로젝트가 촉발한 개인용/기업용 에이전트의 확산은 AI 소비 구조를 '채팅'에서 '자율 수행'으로 전환했습니다. 특히 OpenClaw 창업자의 OpenAI 합류와 해당 프로젝트의 파운더리 주도 오픈소스화는, 에이전트가 더 이상 실험적 기능이 아닌 프런티어 랩들의 핵심 제품 방향성이 되었음을 의미합니다.

• 토큰 소비의 기하급수적 팽창: 에이전트 워크플로우는 다중 에이전트의 병렬 작동과 확장된 컨텍스트 윈도우를 전제로 합니다. 단일 코딩 세션에서만 100만~300만 개의 토큰이 소모되는 구조이며, 이는 기존 챗봇 대비 수십 배의 추론 비용을 야기합니다.

• 계층적 라우팅(Tiered Routing)의 필연성: 토큰 소비가 폭발함에 따라 C-레벨 경영진은 '지속 가능한 비용 구조'를 위해 계층적 모델 배치를 강제하고 있습니다. OpenRouter 통계에서 중국발 저비용 모델(MiniMax, Kimi 등)이 사용량 상위권을 점유하는 이유는, 에이전트의 루틴한 실행(Execution) 레이어에 '충분히 좋은' 저가형 엔진을 배치하는 전략이 보편화되었기 때문입니다.

4. 기술 패권의 재정의: 'Compute Race'에서 'Data Movement Race'로

이제 단순히 GPU 개수를 늘리는 것은 더 이상 차별화된 경쟁 우위가 아닙니다. 1만 개 이상의 가속기 규모에서는 개별 칩의 성능보다 시스템 전체의 효율성(인터커넥트, 메모리 대역폭, 네트워크 토폴로지)이 이익률을 결정합니다. 즉, AI 경쟁은 연산 속도가 아니라 데이터가 칩 사이를 이동하는 속도를 다투는 '데이터 이동 레이스(Data Movement Race)'로 진화했습니다.

이 분야의 선두주자인 Google Cloud의 영업이익률 변화는 시사하는 바가 큽니다. 2024년 9%였던 이익률이 2026년 초 30%까지 수직 상승한 배경에는 TPU(Ironwood/v7), 광학 스위칭(OCS), 맞춤형 네트워크 스택으로 이어지는 수직 계열화가 있습니다.

• 시스템 효율의 격차: NVIDIA GB200 배포 환경의 인터커넥트 대역폭이 400 Gb 수준인 반면, 구글의 TPUv7 아키텍처는 4.8 Tb에 달합니다. 1만 개 규모의 클러스터에서 시스템 효율은 개별 칩 사양보다 총소유비용(TCO) 및 추론 단가에 훨씬 더 큰 영향을 미칩니다.

• 수직 계열화의 재무적 가치: 마이크로소프트와 OpenAI가 자체 실리콘(Maia, 맞춤형 ASIC) 개발을 위해 Broadcom 등과 협력하는 이유는, 인프라에 대한 통제력 없이는 추론 경제 시대의 마진 확보가 불가능하기 때문입니다.

5. 글로벌 전략 지형도: 미·중의 다차원적 최적화 경쟁

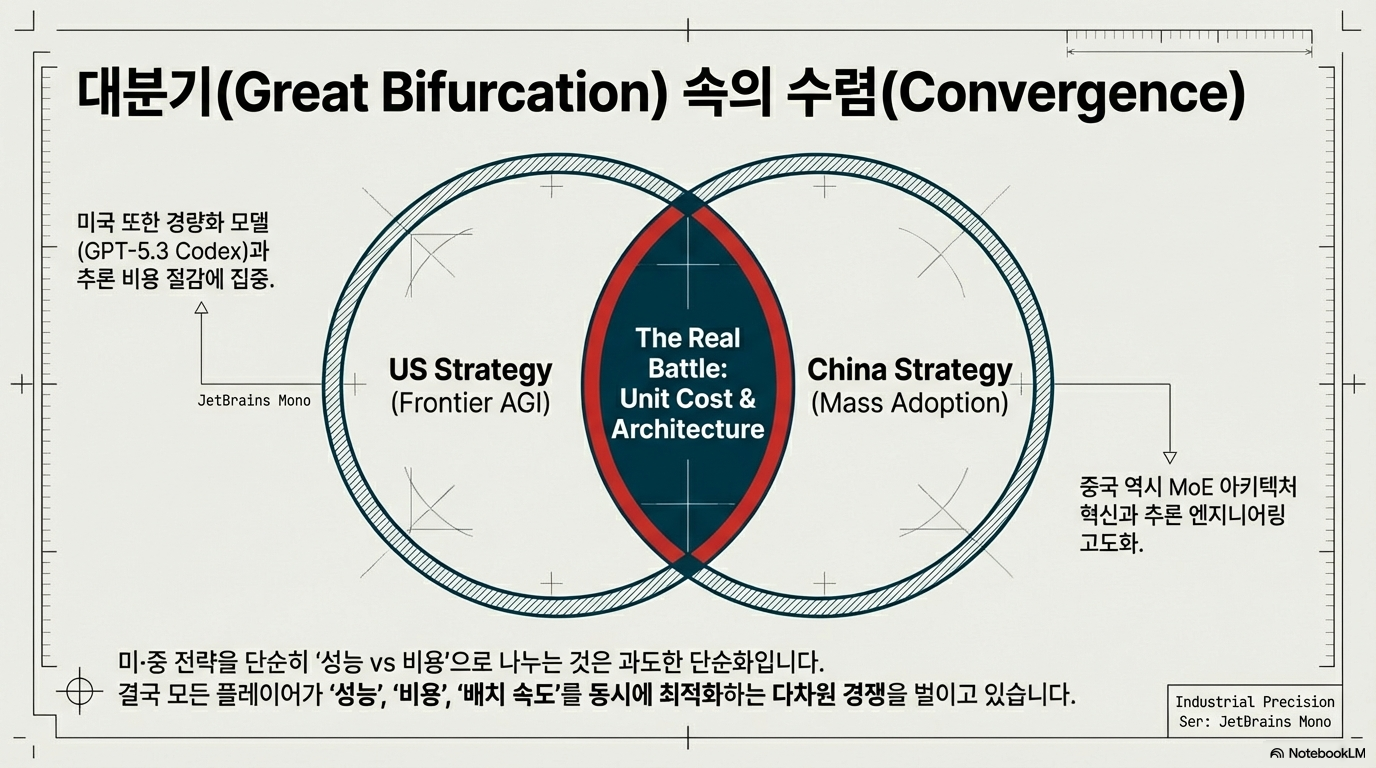

미국과 중국의 AI 경쟁을 '성능 vs 비용'이라는 단순 이분법으로 보는 것은 위험합니다. 현재의 지형도는 성능, 비용, 배치 속도를 동시에 최적화해야 하는 다차원적 고차방정식의 형태를 띠고 있습니다.

1. 미국 (Frontier & Vertical Integration): AGI 달성을 위한 대규모 컴퓨팅 투자를 지속하면서도(xAI의 Colossus 등), 동시에 추론 비용 절감을 위한 아키텍처 혁신(GPT-5.3의 효율화)과 자체 ASIC 개발에 집중하고 있습니다.

2. 중국 (Efficiency & Agent Ecosystem): MoE(Mixture-of-Experts) 아키텍처와 추론 엔지니어링 능력을 극대화하여, 에이전트 실행 엔진 시장을 빠르게 장악하고 있습니다. OpenRouter 데이터에 따르면 상위 5개 모델 중 4개가 중국발 모델일 정도로, 저비용 고효율 엔진으로서의 입지를 굳히고 있습니다.

6. 결론 및 전략적 제언: 지속 가능한 수익성을 위한 C-레벨 가이드

2026년 추론 경제 시대에 기업이 승리하기 위해서는 AI를 소프트웨어가 아닌 에너지와 시스템 공학의 결합체로 다루어야 합니다. 경영진이 즉각적으로 실행해야 할 3가지 핵심 전략은 다음과 같습니다.

1. 컴퓨트 스택의 수직적 통제력 및 시스템 효율성 확보: 단순히 가속기를 대량 구매하는 전략에서 벗어나야 합니다. 인터커넥트 대역폭과 에너지 효율을 중심에 둔 아키텍처 설계가 실제 이익률을 결정합니다. 특히 '데이터 이동(Data Movement)' 효율성이 낮은 인프라는 미래의 막대한 부채가 될 것임을 명심하십시오.

2. 지능의 원가에 기반한 'Inference Engineering' 체계 구축: 모든 업무에 고가의 프런티어 모델을 투입하는 것은 재무적 자살 행위입니다. 과업의 복잡도에 따라 모델을 자동 배정하는 '계층적 라우팅' 시스템을 구축하고, 모델의 활성 파라미터 수와 실제 추론 단가를 연동하여 관리하는 재무 가이드라인을 수립하십시오.

3. 학습 중심에서 '지속 가능한 유틸리티 운영'으로 조직 역량 재편: AI는 더 이상 연구실의 프로젝트가 아니라 상시 가동되는 유틸리티입니다. 대규모 에이전트 실행 환경에서의 토큰 소비 효율을 극대화할 수 있는 전용 워크플로우를 내재화하고, 이를 뒷받침할 수 있는 안정적인 전력 및 데이터센터 공급망을 확보하십시오.

AI는 더 이상 기술의 영역이 아닙니다. 추론 경제에서 승리하는 기업은 가장 똑똑한 모델을 보유한 곳이 아니라, 단위 지능을 가장 낮은 비용으로 중단 없이 공급할 수 있는 시스템을 구축한 곳이 될 것입니다.

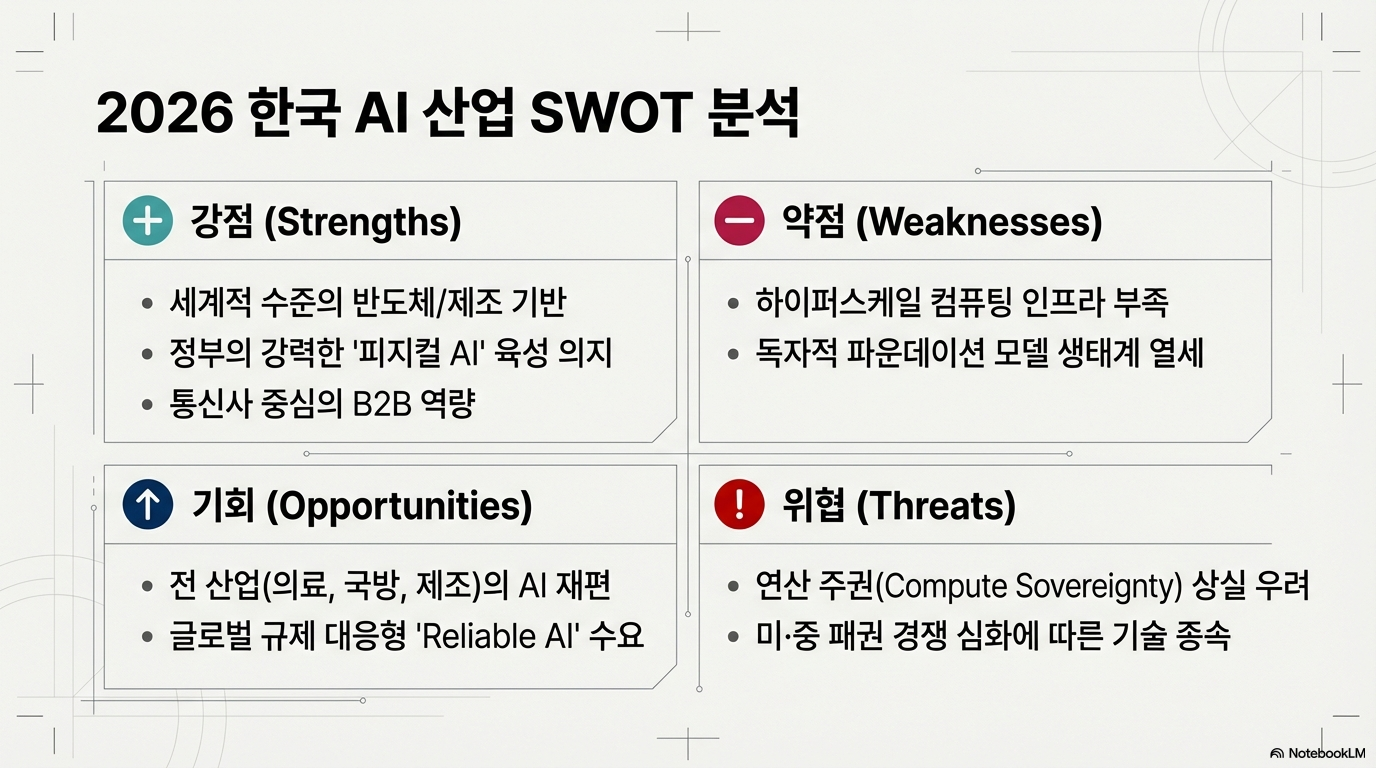

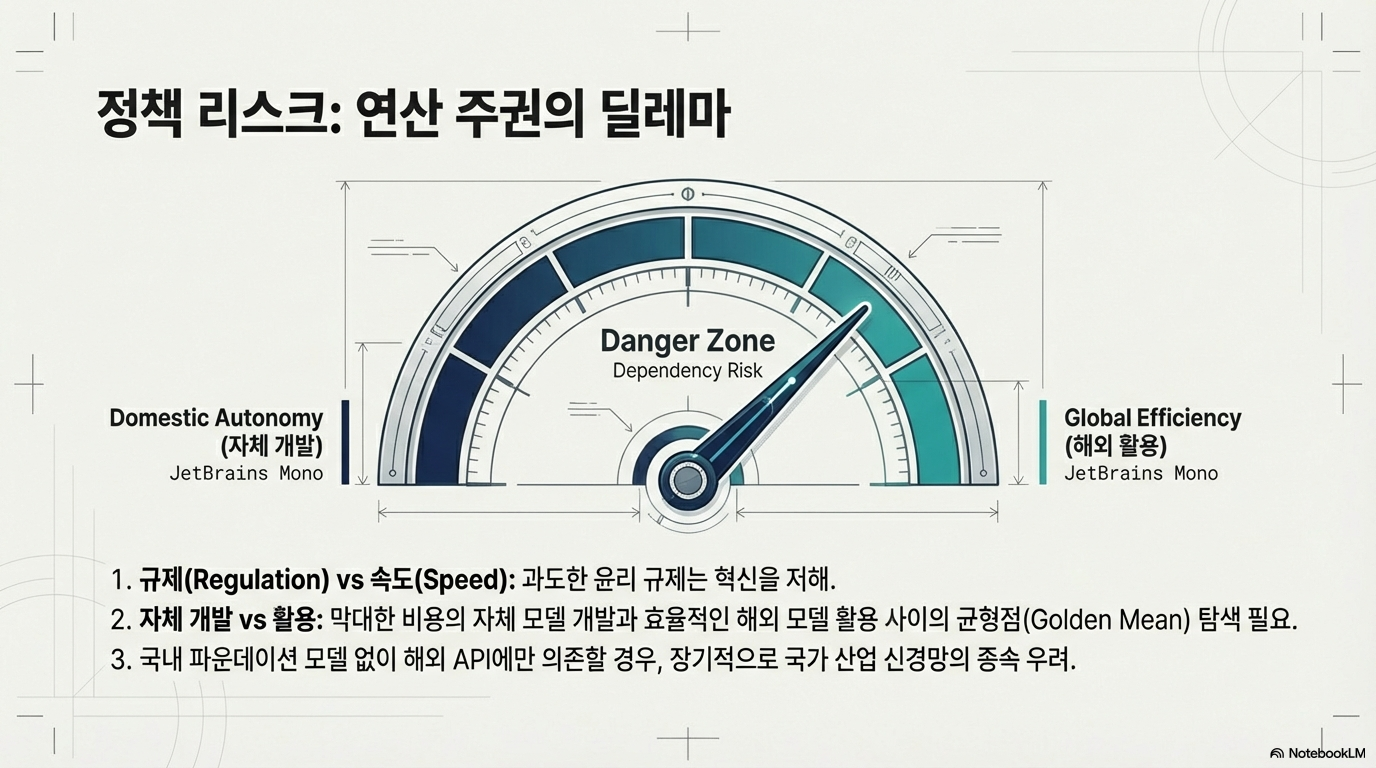

그리고 대한민국.

'12. 메일진 > 3.AI 비용' 카테고리의 다른 글

| 인공지능 - AI 반도체 - 글로벌 AI 칩 소유 현황 (0) | 2026.04.07 |

|---|---|

| 생성형 AI - 추론 ‘inference’ 비용 - 속도 최적화 (0) | 2026.02.22 |

| 생성형 AI - 추론 ‘inference’ 비용 (1) | 2026.01.27 |

| 2025 - OpenRouter, “State of AI” (100조 토큰 실제 사용 데이터 기반, Retention/Cohort 분석 포함) (0) | 2025.12.14 |

| LLM - 가중치 (Open Weight) - 글리치(glitch) 토큰 (0) | 2025.10.08 |