728x90

반응형

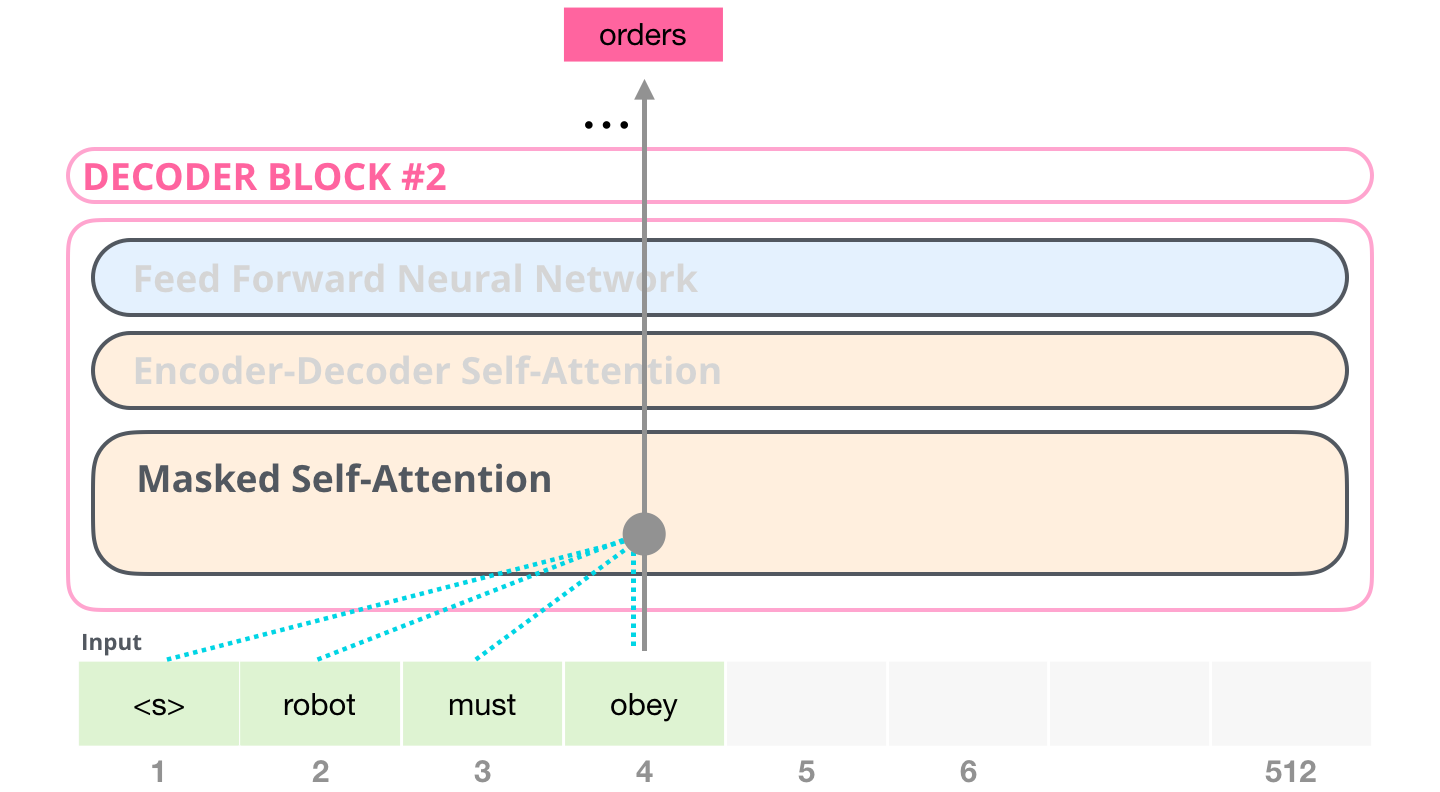

(개념) OpenAI의 트랜스포머 디코더 기반 자동회귀(Auto regression)을 이용한 단방향 언어모델 (비지도 학습)

-

예측한 토큰이 다시 입력으로 들어가며 반복해서 토큰을 생성 (자동회귀)

- BERT의 경우 모든 입력 시퀀스 전체에 대한 셀프 어텐션을 수행하나, GPT-2의 경우 현재까지 예측한 토큰까지만 마스킹 처리

http://aidev.co.kr/9538

챗봇 딥러닝 - 그림으로 아주 쉽게 설명한, The Illustrated GPT-2

시각화의 장인 Jay Alammar가 설명하는 GPT2입니다. 정말 쉽게, 그리고 매우 자세히 모델의 동작방식을 보여주고 있습니다. GPT2는 BERT와 마찬가지로 트랜스포머가 기반입니다. 다만 BERT는 트랜스포머

aidev.co.kr

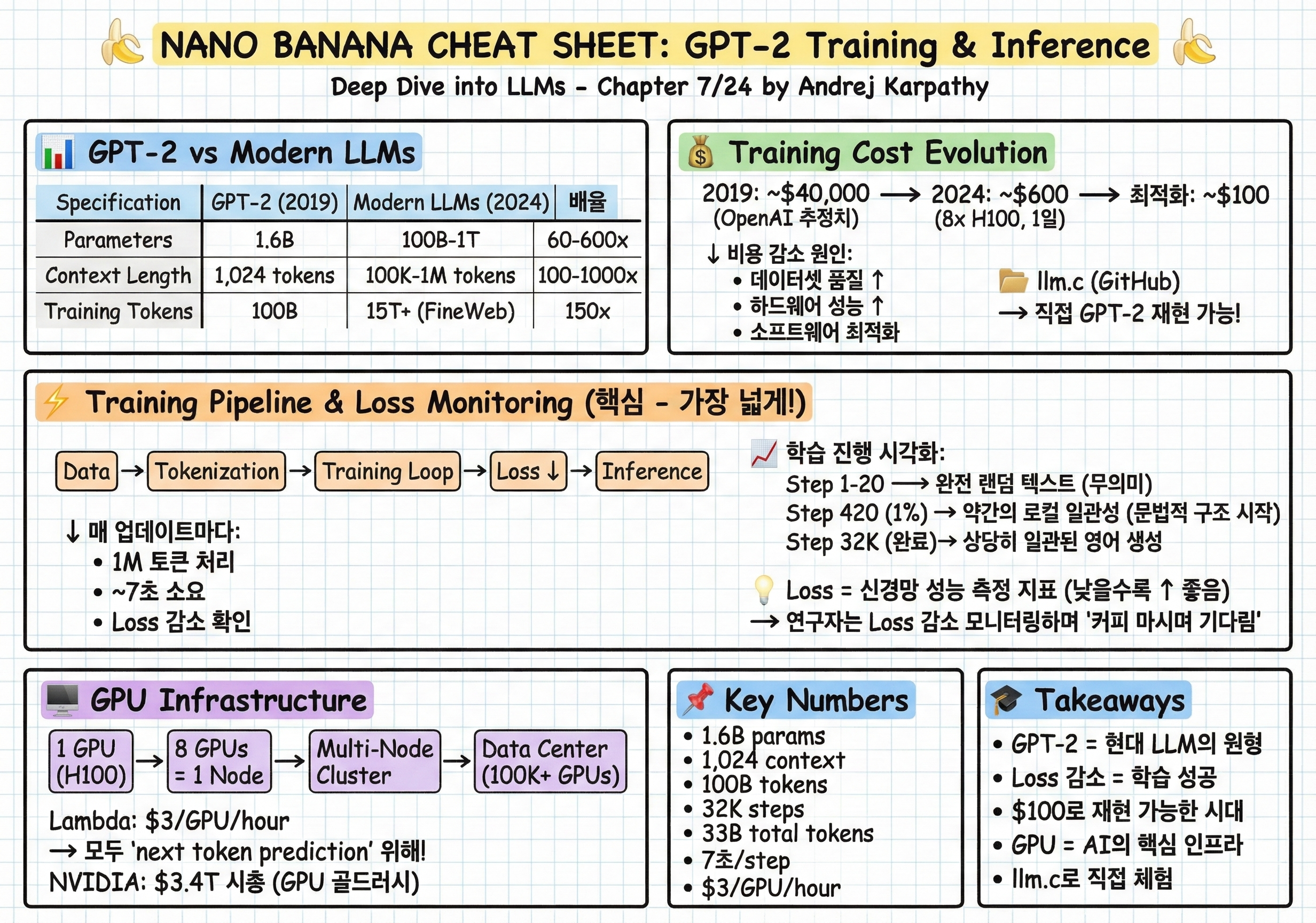

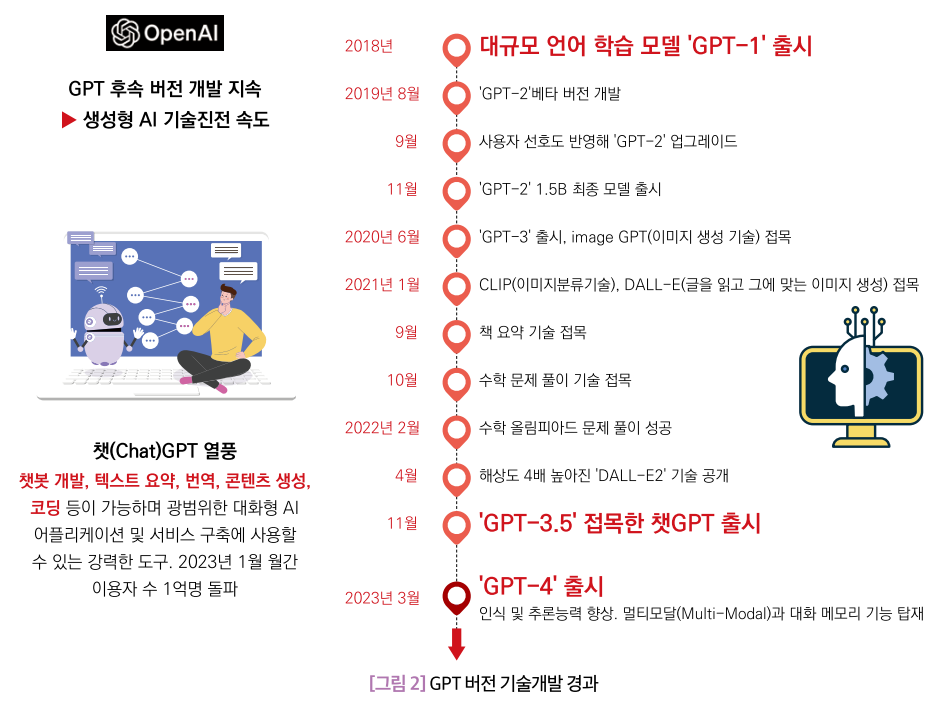

2018년 생성형 사전학습(Generative Pre-Training, GTP)을 제안하여 다양한 자연어 처리를 위해 학습된 언어 모델을 재학습시키는 접근을 취했고, 2019년에는 개선된 GTP인 GTP-2를 공개

(문제) 범용적인 자연어 처리 모델은 과업에 따라 여전히 미세조정(Fine-Tuning)*해야 하는 비용이 필요하여 이것을 점진적으로 개선할 필요성 존재

* 이미 학습된 인공신경망을 유사한 과업에 전이(Transfer)하기 위해 가장 보편적으로 사용하는 방법으로 학습하고자 하는 과업에 데이터를 바탕으로 재학습하는 과정

728x90

'07.AI' 카테고리의 다른 글

| 인공지능 - 법/규제 - 미국 - AI 행동 계획 (0) | 2026.01.31 |

|---|---|

| LLM - 딥시크 (DeepSeek) (4) | 2026.01.27 |

| 생성형 AI - 추론 ‘inference’ vs ‘reasoning’ (1) | 2026.01.27 |

| LLM - LG, K-엑사원(EXAONE) (0) | 2026.01.20 |

| 자연어처리 (NLP) - 과업 지향 대화 (Task-oriented Dialogue, ToD) (0) | 2026.01.13 |