728x90

반응형

https://huggingface.co/blog/moe-transformers

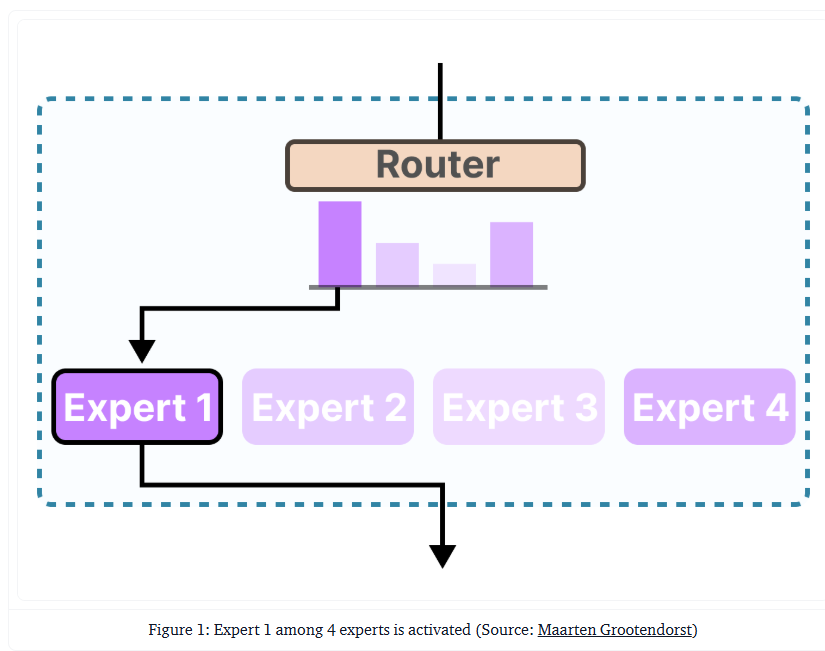

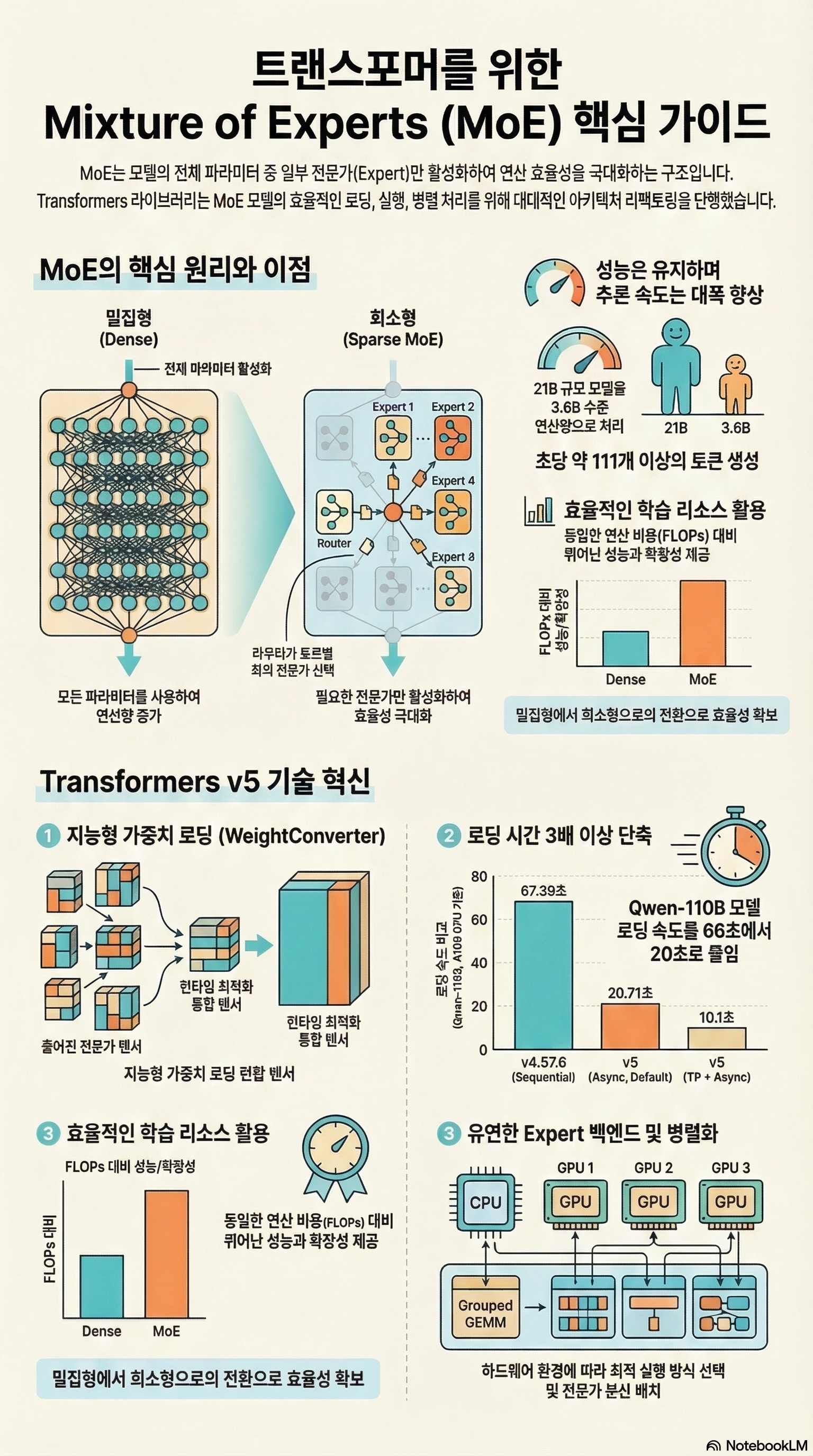

이 문서는 Hugging Face의 Transformers 라이브러리가 Mixture of Experts (MoEs) 모델을 효율적으로 지원하기 위해 도입한 기술적 혁신을 다룹니다. 기존의 밀집형 모델과 달리 MoE는 특정 토큰에 필요한 전문가 네트워크만 활성화하여 연산 효율성과 모델 용량을 동시에 확보합니다. 이를 위해 라이브러리는 가중치 로딩 파이프라인을 재설계하여 병렬 처리와 메모리 최적화를 달성했으며, 다양한 전문가 백엔드를 통해 실행 속도를 높였습니다. 또한 전문가 병렬화 기술을 도입해 초거대 모델을 여러 장치에 분산 처리할 수 있도록 구조를 개선했습니다. 결과적으로 이러한 업데이트는 MoE 모델의 학습 및 추론 성능을 획기적으로 향상시켜 더 적은 비용으로 고성능 언어 모델을 운용하게 해줍니다.

728x90

'07.AI' 카테고리의 다른 글

| 인공지능 - 에이전트 AI - MiniMax, 올리브 송이 제시하는 지능의 본질과 에이전틱 AI의 미래 (0) | 2026.04.03 |

|---|---|

| 인공지능 - 법/규제 (2) | 2026.03.15 |

| SW 테스트 - 정적 테스트 - 코드 리뷰 (Review) - 무신사의 AI 코드 리뷰 프로세스 구축기 (0) | 2026.03.05 |

| 인지 - 인지 부채 (가속된 개발 속도와 이해의 불균형) (0) | 2026.03.05 |

| LLM - 가중치 (Open Weight) - 2026년 1월,2월 (0) | 2026.03.02 |